Come abbiamo potuto osservare nelle lezioni precedenti, tipicamente l'interazione con i chatbot basati sui modelli generativi si basa sull'invio di prompt. L'utilizzatore formula una richiesta e riceve una risposta dal servizio, ad esempio ChatGPT o Bing Chat che, tra l'altro, si basa anch'esso su GPT. Giunti a questo punto il sistema lascia aperta la sessione, rimane in attesa di ulteriori input (i prompt, appunto) per proseguire la conversazione, approfondire quanto esposto nell'output precedente o correggere eventuali inesattezze.

Un approccio differente prevede invece che l'utente possa pianificare degli obbiettivi e lasciare che sia il modello ad operare automaticamente per suo conto. A questo riguardo non parliamo semplicemente di "AI" ma più propriamente di Autonomous AI Agent, come nel caso di Auto-GPT. Si tratta nello specifico di una piattaforma Open Source, per il momento ancora in fase sperimentale, pensata per concatenare i "pensieri" di GPT-4 in modo che esso sia in grado di raggiungere da solo il risultato atteso dall'utilizzatore.

Vantaggi e svantaggi di Auto-GPT

Rispetto a ChatGPT, Auto-GPT ha anche il vantaggio di potersi collegare ad Internet e di analizzare le pagine Web al loro stato attuale. Ciò consente di ricevere in output delle informazioni aggiornate. A ciò si aggiunga il fatto che per installarlo e utilizzarlo non è necessario disporre di un terminale particolarmente avanzato, basta disporre di un PC o di un Mac dotato di processore, memoria RAM e GPU sufficienti alle comuni attività di sviluppo e produttività.

Come anticipato, si tratta di un'applicazione ottimizzata per GPT-4. Se non si ha accesso alle API di quest'ultimo è comunque possibile operare anche con GPT-3.5, tenendo però conto che gli output potrebbero non essere altrettanto precisi. Un'ulteriore avvertenza riguarda il consumo di token. Lavorando in autonomia Auto-GPT tende infatti a consumarli in gran numero. Si consiglia quindi di settare dei limiti precisi tramite il file di configurazione che analizzeremo a breve.

Requisiti per installare Auto-GPT

L'esempio di installazione proposto in questa lezione riguarda l'ambiente Windows, i requisiti software sono però gli stessi anche per chi lavora sui sistemi operativi basati su Linux o macOS.

Python e Git

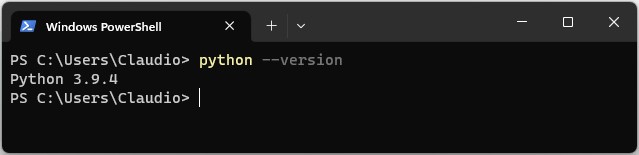

Il primo passaggio da effettuare consiste nel verificare che sul terminale sia presente e attivo un ambiente Python funzionante. Lanciamo quindi da PowerShell, Terminale o Shell il comando di controllo:

python --versionSe l'invio dell'istruzione dovesse generare un output come il seguente si potrà proseguire, diversamente si dovrà procedere con l'installazione di Python.

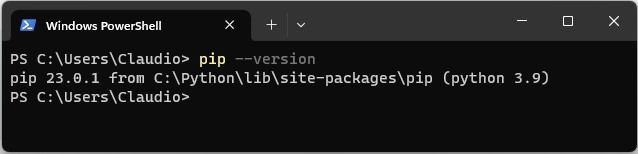

Nello stesso modo si dovrà verificare che nel sistema sia installato pip, il package installer di Python:

pip --version

Se quest'ultimo dovesse risultare assente bisognerà infatti installarlo.

Auto-GPT richiede infine la presenza nel sistema del DVCS (Distributed Version Control System) Git, per la cui installazione (molto semplice) vi rimando alla guida apposita.

Auto-GPT: installazione

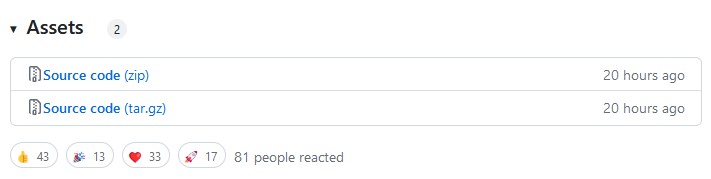

Gli sviluppatori di Auto-GPT mettono a disposizione degli archivi compressi in diversi formati nei quali sono presenti tutti i file dell'applicazione.

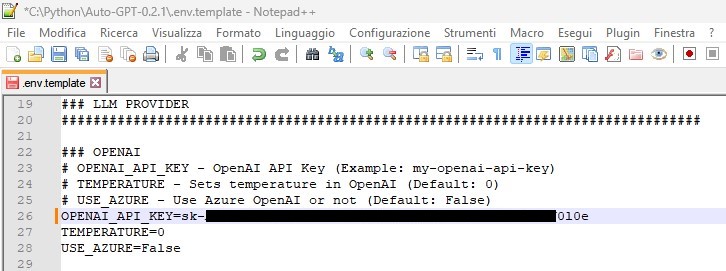

Una volta scaricato l'archivio di nostro interesse, ad esempio quello in formato .zip, lo si deve scompattare. Si ottiene così una cartella da collocare in una posizione a scelta. All'interno di essa è presente il file chiamato .env.template da aprire con il proprio editor di codice preferito.

Il file di configurazione di Auto-GPT

Si tratta nello specifico del file di configurazione di Auto-GPT che, tra le varie direttive, presenta anche quella dove indicare la API Key di OpenAI da utilizzare per l'interazione con GPT.

Qui trovate le istruzioni per la generazione rapida della API Key. OpenAI fornisce anche un credito gratuito limitato nel tempo che permette di testare le proprie interfacce.

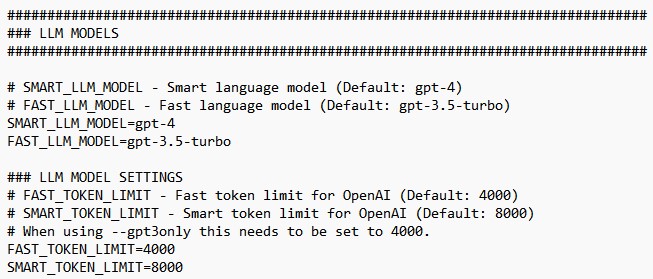

Sempre in .env.template è possibile settare i modelli generativi da utilizzare (indicando quello più "intelligente" e quello più "veloce") nonché i limiti di token per ognuno di essi.

Auto-GPT e vector database

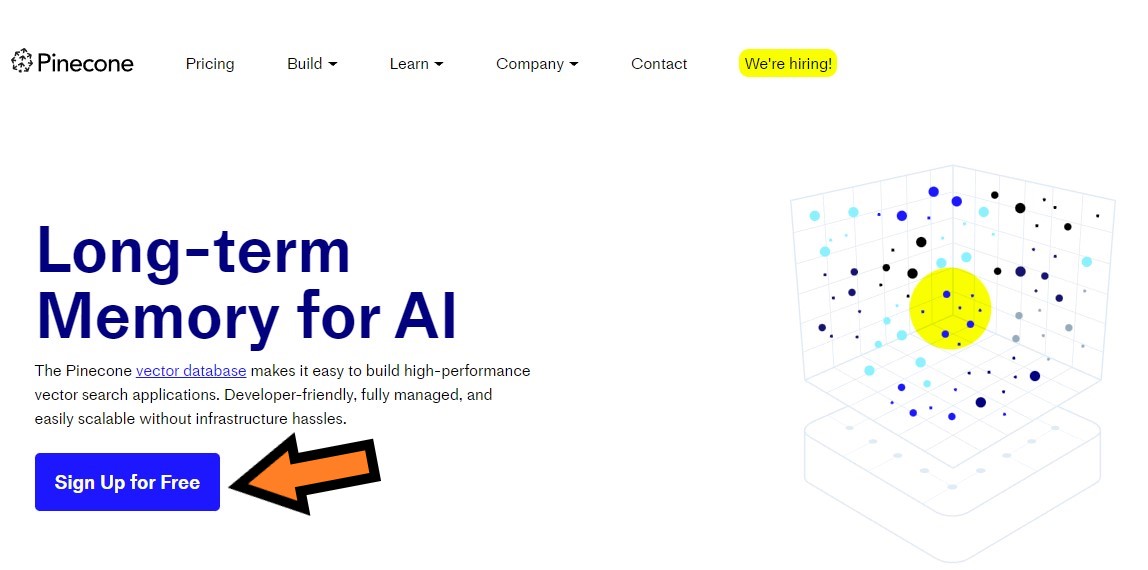

Per rendere la propria istanza di Auto-GPT ancora più performante è possibile anche autenticarsi ad un servizio long-term memory per le AI, come per esempio Pinecone che consente di creare un account gratuito.

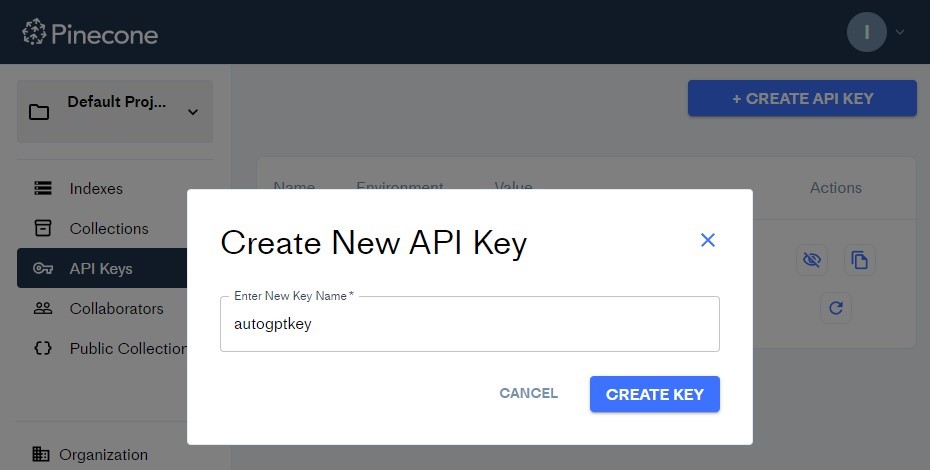

Una volta completata l'iscrizione si può richiedere una API Key a cui attribuire un nome (ad esempio "autogptkey") prima di cliccare su "Create Key".

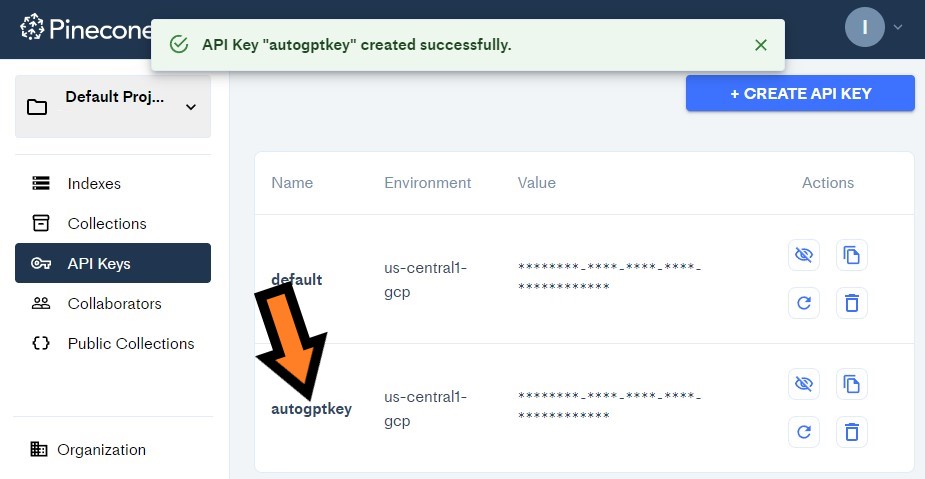

La chiave così generata può essere copiata dalla sezione "API Keys" della propria pagina personale su Pinecone:

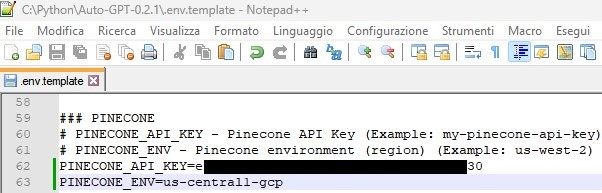

Tale informazione deve essere poi indicata nell'apposita sezione del file .env.template, specificando anche l'area geografica per la connessione che di default è valorizzata con il parametro us-central1-gcp.

Auto-GPT è comunque compatibile con altri supporti di memorizzazione come per esempio Redis, Milvus e Weaviate. Se si utilizzano da tempo vector database differenti è quindi possibile sfruttare una soluzione alternativa a Pinecone.

Auto-GPT: installazione delle dipendenze

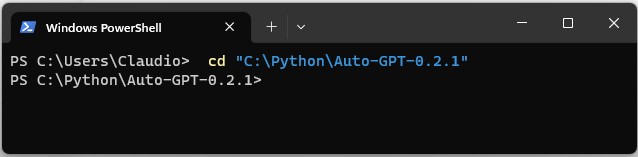

Una volta effettuate le modifiche precedentemente indicate è possibile salvarle per poi rinominare il file .env.template che deve chiamarsi semplicemente .env. Fatto questo il prossimo passaggio consiste nello spostarsi sul percorso nel quale è stata salvata la cartella contenente il package dell'applicazione.

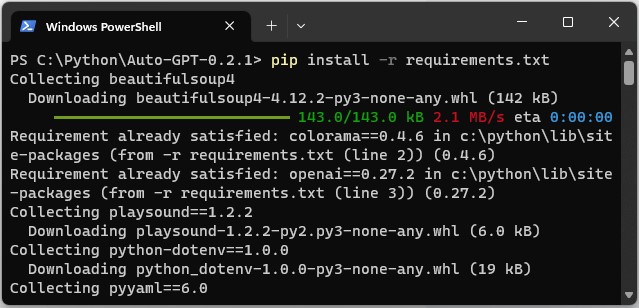

Da questa posizione è possibile installare tutte le dipendenze necessarie per il funzionamento di Auto-GPT. Essendo molto numerose, esse sono state elencate all'interno del file chiamato requirements.txt, ciò ci consente di non doverle installare una ad una. Per integrarle tutte nel nostro sistema basta infatti richiamarle tutte tramite pip attraverso il comando:

pip install -r requirements.txt

L'operazione potrebbe richiedere qualche minuto in virtù della quantità e della grandezza dei pacchetti che devono essere scaricati e installati. Se tutto dovesse andare per il meglio Auto-GPT dovrebbe essere pronto per l'avvio attraverso il comando:

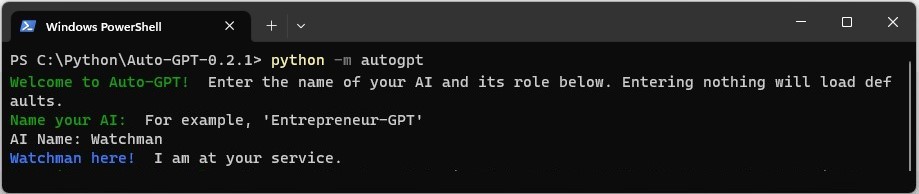

python -m autogptPer tutta risposta l'applicazione dovrebbe mostrarci un breve messaggio di benvenuto, richiedendoci poi di dare un nome alla nostra AI ("Watchman" nell'esempio):

Conclusioni

In questa lezione abbiamo imparato ad installare e configurare Auto-GPT, un'applicazione libera e gratuita che permette di utilizzare il modello generativo GPT lasciando che sia esso a lavorare automaticamente per noi. Auto-GPT può essere definito come un'Intelligenza Artificiale Autonoma, o più propriamente come un esperimento basato su quest'ultima. Testarlo apre le porte alle cosiddette AGI (Artificial General Intelligence), nella prossima lezione vedremo quindi come sfruttarlo per migliorare la nostra produttività, sia nella ricerca di informazioni sul Web che per i compiti legati a sviluppo e programmazione.